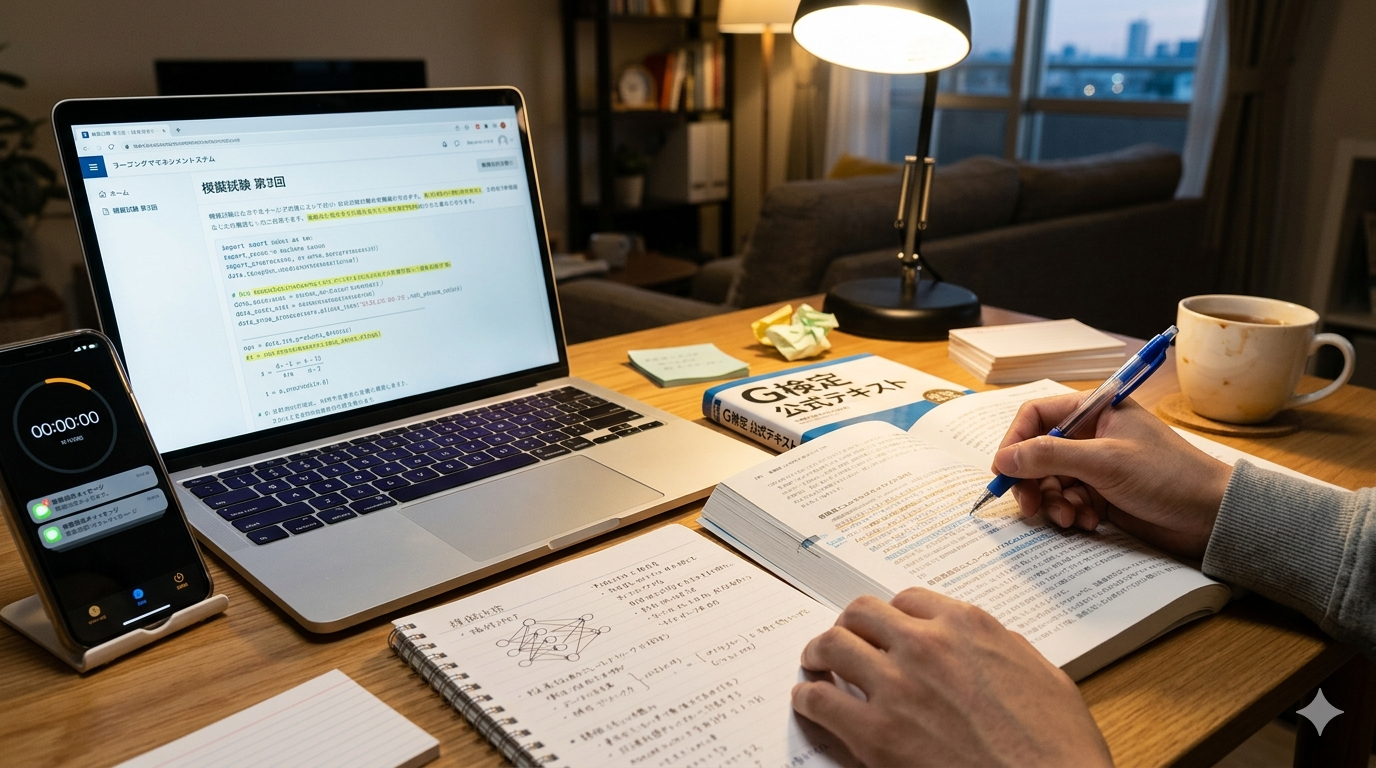

G検定の勉強をしています。

公式テキスト(白本)を1周読み終わり、問題集(黒本)も第10章まで解いた所です。

ここまで勉強した中で思ったことを書いてみます。

読み物としての白本

とりあえず最後まで読みました、とりあえず。

1回で覚えられるわけがないのですが。

職場で始業前の時間とお昼休みに読んでいました。

ガッツリ勉強という感じではないので、読み終わるのに3週間ぐらいかかったと思います。

感想としては

「私にもTransformer搭載してくれ!」

といった感じですかね(笑)

そしたらあっという間に読み終わるのに。

黒本にチャレンジ

まず黒本の目次をペラペラと見ていて気づきました。

「第8章 AIに必要な数理・統計知識」

ぇ?白本にそんな章なかったけども。

そこで本屋に行って、「ベイズの定理」という本を買ってきて読んでみました。

そして黒本にチャレンジした結果、その本はちょっと範囲がズレていました(苦笑)

黒本を第1章から第10章まで1周してみたところ、正答率は50~75%でした。

見たことがない用語がたくさん出てきた感じがあるあたり、私のAttentionは不要な部分の重みを軽くするのではなく、消去してしまっているようです。

再度寄り道

わからない用語を憶えるために再度白本を読むのと同時に、数理・統計知識対策として「数学の世界地図」という本を買ってみました。

本屋で見た感じでは、G検定の学習が終わってからも数学の勉強本として楽しめそうです。

職場では引き続き白本を、家では数学の本を読んで行こうかと思います。

まだ2周目の途中ですが、1周目と違って内容がスッと頭に入ってくる感覚です。

まとめ

白本1周目では頭に入ってこなかった部分も、2周目になるとだいぶ違った感じです。

読みたい本が増えていくので、とりあえずBERTだけでも搭載したい気分です。

引き続き、買い揃えた本をRNN仕様でのんびり学習していこうと思います。

用語の解説(ざっくり)

Transformer:Attention機構を用いて、単語同士の関係を並列に計算できるモデル。文章処理で広く使われ、画像などにも応用されている。

Attention:Transformerの中核となる仕組み。文中の単語同士の関係性(どこに注目すべきか)を計算する仕組み。複数の単語間の関係を同時に扱える。

BERT:Transformerのエンコーダ(文章を理解する部分)をベースにしたモデルで、文の意味理解に強い。

RNN:系列データを順番に処理するモデル。長い文章では初めの情報が伝わりにくくなる(長期依存問題)という課題がある。

※用語の解説は私の独自理解であるため不足がある可能性があります。

コメント